La Inteligencia Artificial Generativa (IAG) llegó en el último tramo de la campaña electoral. Apareció como una novedad ingeniosa con imágenes animadas y spots de fantasía. Sin embargo, de inmediato, el tema se puso un tanto oscuro con la viralización de un video en el que parecía que Sergio Massa tomaba cocaína. Si bien se trató de una fake que se desarticuló enseguida -porque había sido desarrollada de forma rudimentaria-, la pregunta se hizo inevitable: ¿de qué forma puede impactar esta herramienta en la discusión pública?

La IAG es una rama de la inteligencia artificial capaz de generar contenido original -texto, imágenes o videos, por ejemplo- a partir de datos existentes. En el 2023 explotaron la cantidad de aplicaciones que ofrecen este servicio con mayor o menor nivel de complejidad. La posibilidad de creación no tiene límites y su incidencia en los procesos políticos todavía es una incógnita.

En España, por ejemplo, el partido Junts publicó un video en julio -en medio de la campaña- en el que se veía a un falso rey Felipe VI pidiéndole perdón a los catalanes por el referéndum del 2017. En marzo, en Estados Unidos, se viralizó una imagen fake de Donald Trump siendo arrestado. En Eslovaquia, apenas dos días antes de las elecciones del 30 de septiembre, se viralizó un audio en el que se escuchaban dos voces: una era, supuestamente, la del europarlamentario Michal Šimečka y la otra de un periodista. En la conversación discutían cómo podían manipular el proceso electoral o comprar votos.

Los expertos insisten en no demonizar las nuevas tecnologías aunque sí consideran que es necesario reflexionar sobre su impacto. El último líder mundial que se expresó al respecto fue Barack Obama. El expresidente de Estados Unidos se refirió a la posibilidad de una “regulación adecuada” de la inteligencia artificial. “No creo que debamos intentar volver a meter al genio en la botella y ser anti-tecnológicos debido a su enorme potencial. Pero sí deberíamos poner barreras en torno a algunos riesgos que podamos anticipar”, aseguró.

La Inteligencia Artificial Generativa en la campaña electoral argentina: aire fresco para los equipos

La IAG puede ser una aliada de los equipos de campaña. En este 2023 los seguidores de Javier Milei fueron los primeros en empezar a generar imágenes con inteligencia artificial que luego eran compartidas por los mismos candidatos. Los dirigentes libertarios caricaturizados como superhéroes o el sinfín de animaciones con leones, gatos y patos luego de que Mauricio Macri y Patricia Bullrich cerraran filas con el economista.

Natalia Zuazo es especialista en política y tecnología y directora de Salto Agencia. En diálogo con PERFIL habló de los beneficios de este tipo de contenido: “Es barato de producir y genera originalidad en las campañas, que en general tienen poca creatividad”, contó. “Eso en principio está bueno. Es aire fresco. Pero hay dos cosas que se deben tener en cuenta: primero que el contenido tendría que estar alineado a la estrategia general, sobre todo si lo va a usar el candidato. Y lo segundo es que lo tenés que usar en su justa medida, no podés hacer toda la campaña con IA porque vivís en un mundo real con problemas reales”, agregó.

Javier Pallero es director de Contextual, una organización que monitorea desinformación y discursos antidemocráticos. A principios del 2023 su equipo hizo un diagnóstico y concluyó que la IAG no iba a tener una incidencia determinante en esta campaña. “Recién en esta etapa lo registramos, que es una etapa tardía”, contó a PERFIL y agregó: “Vemos que todavía es un fenómeno pequeño pero que va a ser mucho más grande. Hay herramientas económicas al alcance de cualquiera. Hay inversión por parte de los equipos de campaña, pero también hay movilización activista y no rentada. Hay muchos seguidores que ponen plata de su bolsillo y militan así”.

Aunque los libertarios fueron los primeros en hacer un uso fuerte de estas herramientas, los militantes del oficialismo pronto se pusieron a tono. En X, por ejemplo, hay un usuario que comparte imágenes y videos a favor de Massa creados a partir de IAG -Sergio Massa en IA por la Patria-. Uno de los spot, solo en esa cuenta, sumó miles de reproducciones en apenas un rato.

La IAG como amenaza: fake y desinformación

Más allá de los beneficios creativos de la IAG, la gran discusión a su alrededor es hasta qué punto va a colaborar con uno de los problemas actuales más complejos: la desinformación, la manipulación de los datos y las fakes. No es necesario tener grandes habilidades o acceso a aplicaciones sofisticadas para crear un contenido falso pero muy realista.

Según Pallero en Argentina lo que más circula son “cheapfakes”, es decir, contenidos creados con errores o fallas muy visibles. Sin embargo, muchas veces el problema es que aunque la pieza que se genere sea burda, puede llegar a tener efectos. “A veces no es necesario un gran despliegue para que la gente lo crea. Este es un tema que atraviesa todo el problema de la desinformación: no hace falta que sea convincente la noticia falsa sino que tiene que abonar a una teoría que vos ya se venía trabajando en ese público que está ansioso de ver algo horrible sobre el candidato que rechaza”, explicó.

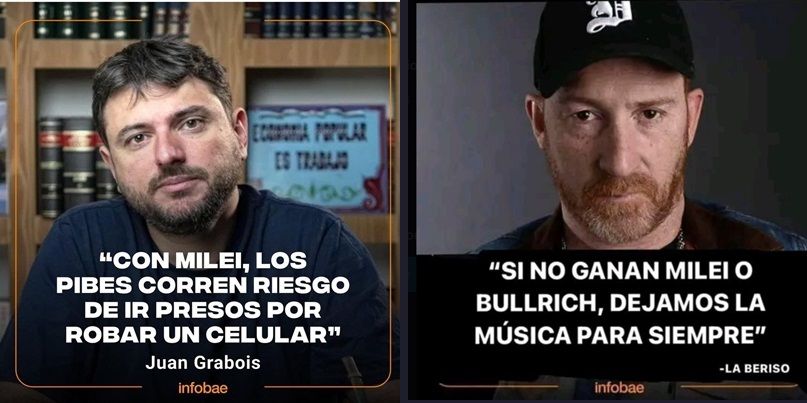

Las placas falsas de Infobae fueron una de las “cheapfakes” con más presencia en esta campaña y hubo para todos los gustos. Sitios de fact checking como Chequeado salieron a aclarar que, por ejemplo, eran falsas las piezas que circulaban de Juan Grabois o del cantante de La Beriso, Rolando "Rolo" Sartorio.

Las animaciones, que comenzaron a tener mayor visibilidad en las últimas semanas, se usaron en general para parodiar al adversario, una práctica legítima en la discusión democrática. En los últimos días se sumaron piezas que utilizan el rostro de alguna personalidad, algo que conlleva un nivel mayor de sofisticación, como el de Taylor Swift en el papel de la dirigente chaqueña Sandra Mendoza, que aportó una cuota de humor al debate.

Sin embargo, el video de Massa fue otra cosa. “En este tipo de videos las aplicaciones más baratas funcionan como filtros de Snapchat y las más avanzadas hacen un mapeo del rostro y crean un modelo de la cara de la persona. En este vemos algún nivel de sofisticación pero también muchas fallas. Si lo analizás cuadro a cuadro podés ver los errores y, además, se encontró el video original. pero con herramientas más avanzadas o con mayor capacidad de címputo es más difícil de detectar”, explicó Pallero.

Es difícil encontrar al responsable de estos contenidos. El abogado y asesor de Unión por la Patria Gregorio Dalbón aseguró a la prensa que ya estaban “determinados los IP” y que iban a llevar a los autores de estos contenidos a la Justicia. Ante la consulta de PERFIL, sin embargo, respondió: “No vamos a darle más entidad al tema”.

A pesar de que esa fake se desarticuló enseguida, hay algo que siempre queda dando vueltas y que sirve -de mínima- para que algunos puedan “jugar” en las redes. Durante el debate, por ejemplo, la diputada electa Lilia Lemoine publicó una captura en la que se ve a la intérprete haciendo un gesto que suele usarse para hablar de cocaína cuando aparece Massa. Sus seguidores, como era de esperar, le respondieron con comentarios y chistes sobre consumo de drogas.

Inteligencia Artificial en la política: los desafíos de una discusión que acaba de empezar

Zuazo subrayó que “en el 2024 vamos a ver un fuerte debate sobre esto porque va a haber elecciones en Estados Unidos y muchos países de América”.

“Están pasando cosas. En Estados Unidos se está evaluando generar una advertencia en los contenidos generados por IAG. Es difícil de aplicar pero se està pensando. Algunas compañías como Meta están baneando estos contenidos en los ads políticos o dan de baja deep fakes. TikTok tiene otro tipo de reglas y por las características de la plataforma es muy difícil regularlo sin afectar a la identidad misma de las personas que están en la red”, explicó.

Inteligencia Artificial: cuáles son las regulaciones que se impulsan en el mundo

Pallero coincide en las dificultades que tiene pensar en una regulación. “Se pueden pensar en algunos límites, especialmente a cómo funciona, por ejemplo, la economía extractivista de datos de las grandes plataformas digitales. Que los contenidos que más se muestran en el feed sean siempre los más sensacionalistas es una elección de diseño de las plataformas y bien podrían establecerse otros criterios”, subrayó.

Es difícil reconocer las implicancias de este tema en los sistemas democráticos. En China, por ejemplo, hace ya algunos años que se desarrolló a una periodista con inteligencia artificial para que lea las noticias. “Algunos regímenes ya no tienen ni que molestarse por pagarle a un comunicador sino que lo crean”, Pallero. El debate, por ahora, recién llega a la Argentina.