2025 quedará en la historia como el año en que Argentina conoció en serio el impacto del verdadero peligro que representan las deepfakes. Si bien hemos visto varios casos en años anteriores, la inteligencia artificial se ha transformado en una herramienta de uso masivo y público, con un inevitable impacto en los comicios electorales.

Los videos difundidos de Macri, Milei, Taiana y Kicillof –como para que entendamos que esto no es propio de un único sector sino que todos los espacios políticos están en riesgo– son solo algunos de los innumerables casos que conocimos este año de este fenómeno, que cada vez será peor.

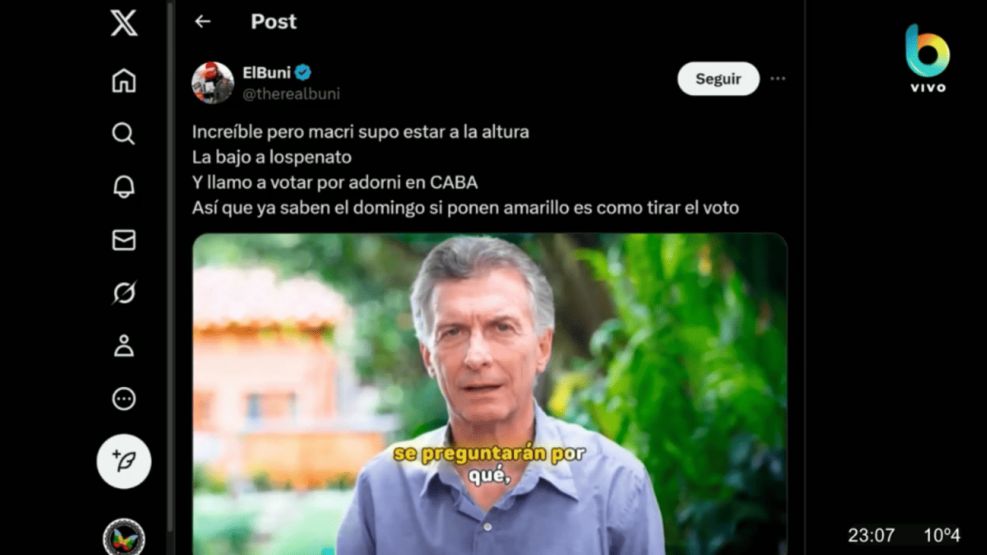

Este año los tuvimos verdaderamente a todos: desde un Mauricio Macri anunciando la baja de la candidatura de su candidata Silvia Lospennato y llamando a votar por Manuel Adorni en las elecciones legislativas de la Ciudad Autónoma de Buenos Aires hasta un Jorge Taiana renunciando a su candidatura días previos a los comicios de octubre.

Ambos casos, al igual que los ejemplos de Javier Milei y Axel Kicillof despotricando contra sus opositores (algo que, quizás, tenga tanto de coyuntura como de innovación tecnológica), fueron solo algunos de los tantos casos que observamos en este año premundialista. Según datos de la fiscalía electoral, en las elecciones de octubre se realizaron más de 360 denuncias por violaciones a la veda electoral, en su mayoría, por difusión de contenido falso generado con IA.

Quizás el primero de los ejemplos mencionados, el de Mauricio Macri en mayo de este año, se haya transformado en el primer viral de relevancia hecho por inteligencia artificial pensado para intervenir definitivamente en la arena política argentina.

Sin embargo, son muchas las personas que suelen defenderse bajo el escudo del “nadie puede ser tan idiota para no darse cuenta que esos videos son falsos”. Y puede que algo de verdad haya en esa afirmación —especialmente por la baja calidad técnica de algunos materiales difundidos este año—, pero lo que está en juego es mucho más que una distorsión de un hecho puntual sino la erosión de la confianza en la información y también en las figuras públicas.

Como si fuese un verdadero golpe de nocaut al ya bastardeado ecosistema informativo y político. Ese daño simbólico puede ser tan grave como la eventual manipulación del voto en una elección legislativa.

“En 2025, la imagen ya no garantiza nada. La lógica de ‘lo vi, por lo tanto ocurrió’ dejó de ser válida. (…) Con la llegada de los deepfakes, ese pacto entre la imagen y la verdad se rompió” asegura Joan Cwaik, en el capítulo sobre el algoritmo y la verdad de su imperdible libro El algoritmo.

Allí reside el verdadero desafío: si la desinformación ya había lastimado la credibilidad de la palabra escrita, las deepfakes dan un paso más al implantar recuerdos falsos, aprovechando el impacto emocional que un video ejerce sobre nuestro cerebro.

Lo que nos ocurrió con los textos empieza a ocurrir con los videos. Triste, solitario y final, tituló su novela el enorme Pepe Soriano. Y algo de ese destino parece sobrevolar si no afinamos nuestros sentidos. Solo una mirada crítica podrá salvarnos ante un Milei defendiendo el socialismo, un Kicillof anunciando la extinción del peronismo o un Macri exigiendo más regulaciones para un Estado gigantesco.

La política tradicional —y también los medios— quedó desacomodada frente a herramientas y formatos que no comprende ni maneja. Las respuestas, previsiblemente, llegan tarde y exponen más falencias que soluciones. Las leyes tampoco alcanzan. Más allá de algunos proyectos valiosos, como el impulsado por la propia Lospennato, regular la circulación, denuncia y remoción de deepfakes es una tarea titánica.

Y más aún si se pretende hacerlo sin vulnerar los marcos de libertad de expresión y prensa, principios que deben seguir siendo intocables.

Detectar hoy si un video fue generado con inteligencia artificial se vuelve cada día más complejo, a medida que las herramientas evolucionan a un ritmo vertiginoso.

Aun así, existen algunos recursos paliativos. La búsqueda de detalles anómalos (fondos difuminados, parpadeos irregulares, sombras incoherentes), rastrear la fuente original del material y chequear las cuentas oficiales de quienes aparecen en pantalla. ¿Difícil? Por supuesto. Pero no imposible, e imprescindible si queremos dejar de alimentar de una buena vez la cadena de desinformación.